Китайский стартап Fire-Flyer заявил о создании модели искусственного интеллекта DeepSeek, способной конкурировать с ведущими разработками OpenAI и Anthropic при значительно меньших затратах

|

Конкурент ChatGPT. Что известно о китайском ИИ DeepSeek

|

Китайский стартап DeepSeek обрушил мировые фондовые рынки, выпустив модель ИИ, которая, как утверждает сама компания и эксперты, не уступает ChatGPT от OpenAI, но чьё производство стоит в разы меньше. Что известно о DeepSeek и как она добилась успеха — в обзоре «Газеты.uz».

Что известно о DeepSeek

DeepSeek — стартап, основанный и принадлежащий китайскому инвестиционному фонду High-Flyer. Компания занимается разработкой технологий искусственного интеллекта (ИИ) по образцу чат-бота ChatGPT от OpenAI или Gemini от Google. И DeepSeek, и High-Flyer управляются китайским миллиардером Лян Вэньфэном.

Издание WIRED называет DeepSeek «нестандартным игроком» китайской индустрии ИИ. Компания начинала свой путь как Fire-Flyer, исследовательское подразделение по глубокому обучению при High-Flyer. Годами High-Flyer накапливала графические процессоры и строила суперкомпьютеры Fire-Flyer для анализа финансовых данных. К 2022 году фонд собрал кластер из 10 тысяч высокопроизводительных графических процессоров Nvidia A100, которые используются для создания и запуска систем ИИ. Вскоре после этого США запретили продавать Китаю эти чипы.

В 2023 году Лян Вэньфэн, имеющий степень магистра по компьютерным наукам, решил использовать ресурсы High-Flyer для создания DeepSeek, которая разрабатывала бы передовые модели ИИ с амбициями достичь общего искусственного интеллекта. Своё решение он объяснял научным интересом, а не желанием получить коммерческую выгоду.

В Китае стартап известен тем, что привлекает молодых и талантливых исследователей ИИ из ведущих университетов. DeepSeek также является одной из немногих китайских ИИ-компаний, которая не получает финансирование от технологических гигантов, таких как Baidu, Alibaba или ByteDance.

За последние несколько лет DeepSeek выпустила несколько крупных языковых моделей — технологией, лежащей в основе чат-ботов ИИ. 10 января компания выпустила бесплатный чат-бот DeepSeek-V3 — большую языковую модель с открытым исходным кодом, которая содержит 671 млрд параметров и обучена на 14,8 трлн токенов.

Затраты на модель, как утверждают разработчики, составили около 5,6 млн долларов. Для сравнения — OpenAI потратила на обучение GPT-4 78 млн долларов, а Gemini Ultra обошлась Google в 191 млн долларов.

Компания также заявляет, что DeepSeek-V3 превзошла GPT-4о от OpenAI, Llama 3 от Meta и Claude 3.5 Sonnet от Anthropic в задачах программирования и обработки текста.

Неделю назад компания выпустила ещё одну модель ИИ — чат-бот DeepSeek R1. По словам разработчиков, R1 демонстрирует «впечатляющие» способности к рассуждению и не уступает по возможностям модели o1 от OpenAI, но стоит при этом в разы меньше.

Как и o1, R1 использует метод «цепочки мыслей», при котором модель проходит через несколько промежуточных логических шагов, прежде чем прийти к окончательному ответу. DeepSeek создал R1 на базе V3, задействовав обучение с подкреплением, которое вознаграждало модель за правильный ответ и за решение проблем таким образом, который обрисовывал её «мышление».

R1 получил высокую оценку от исследователей и экспертов за его способность решать сложные задачи рассуждения, особенно в математике и кодировании. R1 похвалил даже руководитель OpenAI Сэм Альтман, назвав её «впечатляющей моделью» с учётом её способностей и стоимости создания.

Количество загрузок приложения DeepSeek резко выросло с момента запуска R1 и оно сейчас возглавляет рейтинги в магазине AppStore.

Чем DeepSeek отличается от других ИИ

Одна из ключевых особенностей DeepSeek — полностью открытый код. В отличие от ведущих американских компаний, занимающихся ИИ (OpenAI, Anthropic и Google DeepMind), которые держат свои исследования почти полностью в тайне, DeepSeek сделала исходный код для всех своих моделей и подробное техническое объяснение программы бесплатными для просмотра, загрузки и изменения. Таким образом, любой человек из любой точки мира может использовать, адаптировать и даже улучшать программу.

Из-за экспортных ограничений США на поставку передовых чипов ИИ DeepSeek пришлось придумать более эффективные методы обучения ИИ-моделей, чтобы конкурировать с OpenAI или Meta. Компания оптимизировала архитектуру своих моделей, усовершенствов коммуникации между чипами, уменьшив объем данных для экономии памяти и применив метод Mix-of-Models.

DeepSeek также добилась успеха в разработке Multi-head Latent Attention (MLA) и Mixture-of-Experts — технологий, снижающих потребность в вычислительных ресурсах и делающих модели более экономичными. Благодаря этому последняя ИИ-модель DeepSeek оказалась настолько эффективной, что для обучения понадобилась лишь десятая часть вычислительной мощности, необходимой для Llama 3.1 от Meta, согласно данным исследовательского института Epoch AI.

Среди недостатков чат-бота DeepSeek называют цензурирование ответов на некоторые темы, связанные с китайскими властями. Журналист New York Times, тестировавший модель DeepSeek, обратил внимание, что чат-бот отказался отвечать на вопросы о протестах на площади Тяньаньмэнь, жестоко подавленных правительством Китая, объяснив это тем, что такая информация «выходит за рамки» его текущих возможностей. На вопросы о минусах Коммунистической партии КНР чат-бот написал, что «в настоящее время испытывает большой трафик» и не может дать ответ, хотя, по словам журналиста, спокойно ответил на вопрос по другой теме несколько секунд спустя.

ChatGPT, к примеру, на вопрос о событиях на площади Тяньаньмэнь, дал детальный ответ, рассказав о предыстории массовых протестов, предполагаемом количестве жертв и последствиях произошедшего, уточняет Associated Press.

Как отреагировали рынки акций

Последние запуски DeepSeek вызвали панику среди инвесторов . Традиционно считалось, что компаниям, занимающимся ИИ, нужны дорогие передовые компьютерные чипы, например, те, что производит Nvidia, для обучения систем. Это оправдывало огромные расходы крупнейших американских технологических компаний, таких как Alphabet и Meta Platforms, отмечает Wall Street Journal.

Но у DeepSeek не было передовых чипов, а её модели, тем не менее, соответствуют ведущим конкурентам в США по определённым показателям, которые оценивают возможности ИИ. Кроме того, DeepSeek выпустила R1 с открытым исходным кодом, что значит, что другие компании смогут использовать подход DeepSeek и потенциально создать другие дешёвые альтернативы ИИ, поясняет WSJ.

На фоне появления последней моделей DeepSeek акции Nvidia упали на 17% в течение торгового дня 27 января. Рыночная капитализация компании из-за падения сократилась более чем на 600 млрд долларов — это самые большие потери для компании в истории фондового рынка, понесённые в один день.

Nvidia стала одним из крупнейших бенефициаров в буме ИИ, поскольку её чипы почти исключительно обеспечивали обучение и во многих случаях работу самых мощных существующих моделей ИИ. Nvidia и инвесторы компании сделали ставку на то, что новые поколения её передовых чипов будут использоваться для разработки самых мощных моделей ИИ. Однако успех DeepSeek показывает, что лидерство Nvidia в разработке чипов ИИ может быть не таким большим и важным для разработки новых моделей ИИ, пишет WSJ.

Акции других компаний, связанных с энергетикой, также упали в понедельник из-за опасений инвесторов, что новой технологии потребуется меньше энергии для работы, а это в свою очередь приведёт к снижению спроса со стороны технологического сектора. Так, акции GE Vernova, производящей ветряные и газовые турбины, упали на 21%, а акции электрогенератора Vistra — на 28%.

Успех DeepSeek в создании модели ИИ может изменить баланс среди игроков на мировом рынке, и это уже воодушевило некоторые страны за пределами США, пишет WSJ. Представители правительства Франции заявили, что пример DeepSeek показывает, что «гибкие» компании с эффективными методами все ещё могут конкурировать в гонке ИИ, имея меньше средств или ограниченный доступ к чипам. Это означает, что возможности догнать американских технологических гигантов есть не только у Китая, но и у ЕС и других стран мира.

«Не уступает ChatGPT, но дешевле»: в Китае разработали свой ИИ, способный рассуждать

Компания Fire-Flyer объявила о выпуске новой модели DeepSeek R1, которая, по заявлению разработчиков, способна «рассуждать» и не уступает последним системам ИИ OpenAI в решении сложных задач. Разработчики заявляют об удивительной экономической эффективности проекта. В условиях санкций и запрета на поставки лучших графических чипов со стороны США, компания сконцентрировалась на минимизации ресурсов для обучения ИИ.

По словам разработчиков DeepSeek, компания потратила менее $6 млн на разработку модели V3 LLM, которую использует R1. Для сравнения создание GPT-4 обошлось OpenAI более чем в $100 млн. Более того, для обучения V3 потребовалось всего 2000 специализированных чипов Nvidia — против 16000, о которых рассказывали конкуренты.

Хотя заявления китайской компании как об удивительной экономичности, так и о том, что модель не уступает лучшим американским системами в некоторых бенчмарках, пока не подтверждены, рынок акций среагировал на выход новой системы. После начала торгов на бирже Nasdaq стоимость акций Nvidia — основного поставщика графических процессоров, используемых для обучения ИИ — опускалась с $142,6 до $122,9, а на 16:20 по московскому времени торгуется по цене около $126.

Если компании действительно удалось существенно сократить затраты на обучение ИИ, это ставит вопрос о целесообразности гигантских инвестиций в инфраструктуру дата-центров. Напомним, на прошлой неделе, например, OpenAI и Oracle заявили, что инвестируют $500 млрд в течение трех лет в ЦОДы для ИИ.

Как ChatGPT: приложения бесплатной нейросети DeepSeek вышли на iOS и Android

Она умеет рассуждать и находить информацию в интернете.

Китайский стартап DeepSeek выпустил на iOS и Android приложения своей одноимённой нейросети. Сервис доступен бесплатно и считается одним из главных конкурентов ChatGPT.

Приложение позволяет общаться с искусственным интеллектом и решать широкий спектр задач — от поиска рецептов до решения сложных уравнений. Нейросеть даёт быстрые и лаконичные результаты, работает на русском языке и доступна в России без каких-либо дополнительных манипуляций.

Одной из особенностей DeepSeek является способность рассуждать. Прежде чем ответить на вопрос пользователя, нейросеть в фоне генерирует цепочку мыслей, постепенно анализирует проблему и приходит к выводу. Есть и возможность искать информацию в интернете. Также в приложение можно загружать изображения и другие файлы для последующей их обработки искусственным интеллектом.

У DeepSeek есть несколько вариантов. Среди них — DeepSeek VL для считывания естественного языка с картинок, DeepSeek Math для работы с математическими задачами, а также версия для написания кода DeepSeek Coder. Последняя понимает 338 языков программирования.

Китайский «чёрный лебедь» DeepSeek уже стал самым популярным бесплатным приложением для iPhone и одним из самых скачиваемых на Android

Приложение чат-бота китайского стартапа DeepSeek взлетело на вершину рейтинга загрузок iPhone, о чем пишет Bloomberg.

Выпуск данного приложения посеял сомнения в Кремниевой долине и на мировом рынке относительно прочности лидерства Америки в области искусственного интеллекта.

Лежащая в основе приложения модель искусственного интеллекта сегодня рассматривается как конкурентоспособная с последними разработками OpenAI и Meta*, при этом в DeepSeek вложено значительно меньше средств.

Акции китайских технологических компаний, связанных с DeepSeek, таких как Iflytek, выросли на торгах в понедельник, в то время как производители инструментов для производства чипов, такие как Advantest Corp., подешевели из-за потенциальной угрозы сокращения спроса на ускорители ИИ от Nvidia. Фьючерсы на американские фондовые индексы также упали на фоне опасений, что модели ИИ от DeepSeek могут подорвать технологическое лидерство США.

Чат-бот DeepSeek, который инвестор Марк Андрессен назвал «одним из самых удивительных и впечатляющих прорывов», сравнимых с запуском первого спутника, возглавил чарт бесплатных загрузок на iPhone в США и является одним из самых скачиваемых приложений в Google Play Store.

Как и все другие китайские модели искусственного интеллекта, DeepSeek самоцензурирует темы, которые в Китае считаются политически чувствительными. В отличие от ChatGPT, DeepSeek отклоняет вопросы о площади Тяньаньмэнь, президенте Си Цзиньпине или возможности вторжения Китая на Тайвань.

Китайская DeepSeek представила ИИ для генерации изображений на волне хайпа

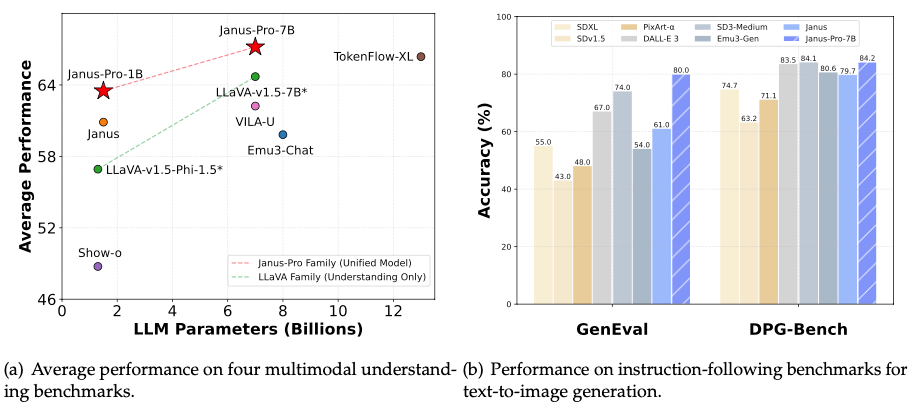

DeepSeek представил новую модель искусственного интеллекта Janus-Pro-7B, которая, по данным технического отчета компании, превзошла популярные системы DALL-E 3 и Stable Diffusion в тестах по генерации изображений. Модель распространяется по лицензии с открытым исходным кодом.

DeepSeek выпустил семейство мультимодальных моделей Janus-Pro с количеством параметров от 1 до 7 млрд. Самая мощная версия, Janus-Pro-7B, по данным компании, продемонстрировала превосходные результаты в тестах GenEval и DPG-Bench, опередив не только DALL-E 3, но и другие известные модели, включая PixArt-alpha, Emu3-Gen и Stable Diffusion XL.

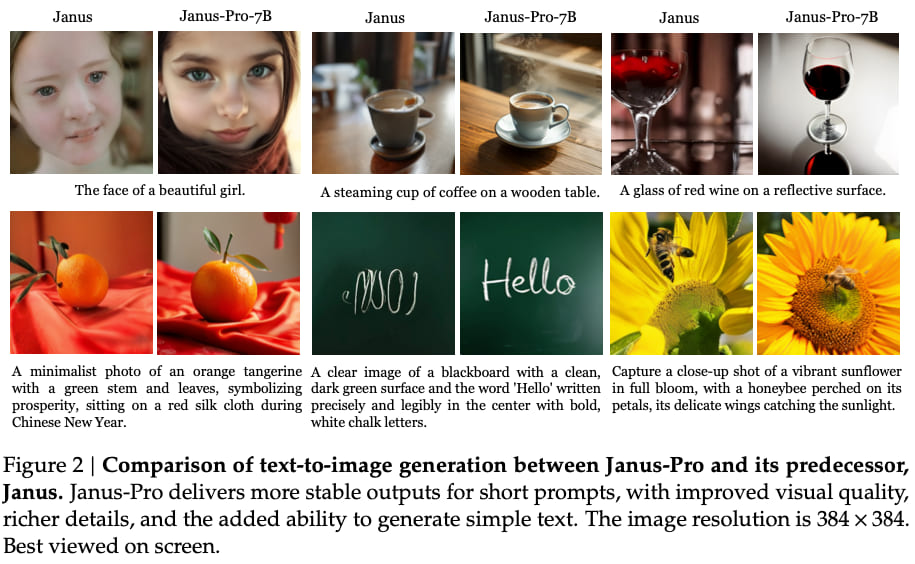

Новая модель — усовершенствованная версия базового Janus, выпущенного в конце прошлого года. По данным компании, улучшения достигнуты за счет оптимизации процессов обучения, повышения качества данных и увеличения размера модели. В частности, для обучения было использовано 72 млн высококачественных синтетических изображений, сопоставленных с реальными данными.

Сравнение старой и новой версии модели Janus. Изображение: DeepSeek

Несмотря на впечатляющие результаты, у Janus-Pro есть определенные ограничения. Большинство моделей семейства работают только с небольшими изображениями разрешением до 384 x 384 пикселей. Однако эксперты отмечают, что такая производительность впечатляет с учетом сравнительно небольшого размера моделей.

Выход Janus-Pro совпал с неожиданной популярностью DeepSeek. На фоне заявлений компании об исключительной экономичности разработки по сравнению с лидерами индустрии — чат-бот поднялся на первое место в магазинах приложений в разных странах мира, а стоимость акций американских компаний, занимающихся инвестициями в ИИ и разработкой чипов для обучения больших языковых моделей, падала.

Успехи китайского стартапа прокомментировали главы OpenAI и Nvidia. Генеральный директор компании, которая разработала ChatGPT, Сэм Альтман назвал модель DeepSeek «впечатляющей» и отметил, что появление нового сильного конкурента воодушевляет компанию на дальнейшее развитие собственных технологий.

Китайцы создали нейросеть, которая превзошла мыслящую OpenAI o1 в важных тестах

Китайская лаборатория искусственного интеллекта (ИИ) DeepSeek представила открытую версию своей модели искусственного интеллекта R1 со способностью к рассуждению, которая, по заявлению разработчиков, превосходит ИИ-модель o1 от компании OpenAI в некоторых бенчмарках по ряду ключевых показателей.

Как сообщает издание TechCrunch, модель R1 превосходит OpenAI o1 в таких бенчмарках, как AIME, MATH-500 и SWE-bench Verified. Эти тесты охватывают различные области, включая математические задачи, программирование и общую производительность модели. AIME оценивает производительность моделей с помощью других ИИ-моделей, MATH-500 представляет собой набор задач по математике, а SWE-bench Verified ориентирован на программирование.

Особенностью R1 является её способность к самопроверке, что помогает исключить ошибки, характерные для других моделей. Однако этот подход требует больше времени для получения ответа — от нескольких секунд до нескольких минут. Тем не менее, такие модели считаются более надёжными в сложных областях, таких как математика, физика и различные науки.

В DeepSeek заявили, что R1 содержит 671 миллиард параметров, что делает её одной из крупнейших моделей в мире. Для удобства пользователей компания также выпустила упрощённые версии R1 с объёмом параметров от 1,5 до 70 миллиардов. При этом, самая компактная версия может работать даже на обычном ноутбуке, в то время как для полного варианта требуется более мощное оборудование. Тем не менее, R1 доступна через API компании по цене, которая, как утверждается, на 90–95% ниже, чем у OpenAI o1.

Отмечается, что у R1 есть и некоторые недостатки. Поскольку модель разработана в Китае, она подлежит обязательной проверке со стороны регуляторов на соответствие «основным социалистическим ценностям». Например, R1 отказывается отвечать на вопросы о событиях на площади Тяньаньмэнь или о независимости Тайваня, что характерно для многих китайских ИИ-моделей, которые избегают обсуждения острых для Поднебесной политических тем.

Стоит сказать, что DeepSeek стала первой китайской лабораторией, вступившей в реальную конкуренцию с OpenAI o1, представив предварительный вариант R1 ещё в ноябре. Однако за ней последовали и другие игроки, включая Alibaba и Kimi, принадлежащую компании Moonshot AI. По мнению исследователя искусственного интеллекта из Университета Джорджа Мейсона Дина Балла (Dean Ball), всё это свидетельствует о том, что китайские ИИ-компании продолжают оставаться «быстрыми последователями» в технологической гонке. «Успех упрощённых версий DeepSeek […] показывает, что мощные рассуждающие модели будут становиться всё более доступными и смогут работать даже на локальном оборудовании», — отметил Балл в своём посте на X.

Источник: