Искусственный интеллект (ИИ) вызывает тревогу у Ватикана. На прошлой неделе Ватикан издал резолюцию по этике использования искусственного интеллекта. Эта резолюция, подписанная совместно IBM и Microsoft, устанавливает ряд принципов разработки и внедрения технологий, основанных на ИИ. Она также обязывает подписавших его участников сотрудничать с Римской католической церковью «в целях продвижения «алгорэтики», то есть этического использования ИИ».

На первый взгляд, резолюция Ватикана является своевременной и исполненной благих намерений. Однако сделать ИИ более этичным вряд ли удастся по ряду существенных причин.

Названная Римским Призывом к этике ИИ резолюция добровольно обязывает подписавшие её стороны придерживаться шести принципов при разработке ИИ:

1. прозрачность,

2. инклюзивность,

3. ответственность,

4. беспристрастность,

5. надежность,

6. безопасность и

7. конфиденциальность.

Учитывая, что искусственный интеллект уже имеет плохую репутацию в плане дискриминации женщин и этнических меньшинств, необходимость рассмотрения его этических последствий с каждым днём становится все сильнее. Поэтому нет ничего удивительного в том, что подписавшие Призыв провозглашают это событие важной вехой в развитии искусственного интеллекта.

Вице-президент IBM Джон Келли также похвалил данную инициативу за то, что в ней сосредоточено внимание на вопросе о том, кто выиграет от роста роли ИИ в нашей жизни:

Нет никаких сомнений в том, что ИИ в частности и IT-индустрия в целом имеют серьезные проблемы, связанные с этикой их деятельности. Однако крайне маловероятно, что инициатива Ватикана по ИИ внесет существенный вклад в гарантированное использование ИИ, опирающегося на этику, приносящего пользу всем, а не только корпорациям и правительствам, использующим ИИ в экономических и политических целях.

Во-первых, несмотря на разговоры о «сотрудничестве» между Церковью, научным сообществом и IT-компаниями, Римский Призыв к этике ИИ не содержит никакой практической, повседневной стратегии для работы над ее более широкими целями. Нет никакого рабочего графика, никаких запланированных встреч, семинаров, конференций или проектов, поэтому трудно представить, как вызывающий похвалы Призыв к более «этичному» ИИ будет фактически реализован на практике.

Призыв к этике ИИ, скорее, является абстрактным побуждением компаний ИИ к разработке этических норм, чем конкретным планом работ над этой темой. Такое предположение высказал архиепископ Винченцо Палья, президент Папской академии жизни, который подписал Призыв от имени Ватикана.

Во-вторых, сами шесть принципов сформулированы туманно и открыты для широкой субъективной интерпретации. Более того, любой, кто имел какой-либо опыт работы с каждым из принципов, понимает, что корпорации и люди воспринимают их совершенно по-разному.

Например, «конфиденциальность» для такой компании, как, скажем, Facebook, вероятно, не является реальной конфиденциальностью. Facebook, конечно же, может гарантировать, что другие члены сообщества каким-то образом не могут просматривать ваши сообщения и фотографии в этой социальной сети. Однако Facebook отслеживает практически всё, что вы делаете на его страницах и вне его сайта, и это не является полной конфиденциальностью. Это приватность от других людей, а не от компаний.

Аналогично IT-компании в будущем могут великолепно обеспечить защиту данных от киберпреступников, использующих в своей незаконной деятельности алгоритмы ИИ. Тем не менее быстрый рост использования ИИ для кражи данных неизбежно приведет к соответствующему быстрому росту получения персональных данных IT-корпорациями и продаже их другим корпорациям. Опять же мы получаем конфиденциальность от людей, а не от компаний.

Похожие замечания можно было бы сделать и в отношении других принципов. В случае прозрачности «объяснимый ИИ» обычно работает только в определенных уровнях сложности, поэтому не каждый аспект ИИ может быть полностью прозрачным и объяснимым. Если говорить по существу, то IT-компании могут объяснить технические параметры, которые они установили для своих моделей ИИ, но не могут объяснить более широкие деловые, коммерческие, социальные и даже политические последствия, которые эти модели могут иметь в будущем.

Кроме того, некоторые из этих принципов содержат в себе тавтологию, что делает их почти бессмысленными. Третий принцип — принцип ответственности — гласит:

Действительно, крайне полезное указание.

Кроме того, существует глубокое заблуждение, которое подрывает сущность двух других принципов — беспристрастности и инклюзивности.

Согласно Призыву к этике ИИ, беспристрастность диктует, что разработчики ИИ не должны действовать предвзято. Возможно, разработчики могут избежать преднамеренной и злонамеренной предвзятости, но предвзятость неизбежна при разработке любого вида ИИ, потому что разработчики должны выбирать определенный набор данных при обучении своих моделей, и они должны задать определенные факторы или параметры, которые любой алгоритм будет использовать для обработки этих данных. Это всегда влечет за собой определенную степень предвзятости, так как ИИ не может включать в себя абсолютно все данные и все параметры.

Иными словами, этические принципы ИИ Ватикана слишком иллюзорны и расплывчаты. Ситуация усугубляется еще и тем, что в самой формулировке задачи по созданию этики ИИ заложена исходная ошибка, которая делает эту задачу неразрешимой. Проблема, которая действительно должна быть решена, это не «этика ИИ», а, скорее, этика каждой компании и организации, которая стремится разработать и внедрить ИИ, а также этика экономической и политической системы, в которой работают эти компании и организации. Как обычно, мы пытаемся лечить симптом, а не болезнь. Поэтому не стоит делать акцент на прозрачности и надежности ИИ-системы, если она будет использоваться компанией, чья бизнес-модель основана на эксплуатации рабочих, обмане потребителей или незаконной слежке и шпионаже.

Ватикан признает существование этих спорных вопросов, даже если призыв к этике ИИ напрямую не затрагивает его. Архиепископ Винченцо Палья говорит:

Действительно, если компании не стремятся быть этичными в целом, то никакие инициативы по «этическому ИИ» не остановят их от использования ИИ неэтичными способами. И в этом отношении интересно отметить тех, кто не подписал принципы ИИ, предложенные Ватиканом. Складывается впечатление, что в настоящий момент подавляющее большинство мировых корпораций хотят использовать ИИ в неэтичных целях.

Тем не менее архиепископ Палья подтверждает, что Ватикан работает над привлечением других корпораций.

Но без большего числа подписантов, без более подробного изложения шести принципов и без рассмотрения основополагающих вопросов социальной, экономической и политической этики «Призыв Ватикана к этике ИИ» вряд ли станет серьезным документом. На данный момент это похоже на PR ход: с одной стороны, Римская католическая церковь может казаться «влиятельной», а с другой стороны, крупные IT корпорации, такие как IBM и Microsoft, могут казаться «этичными». Но будем надеяться, что история докажет ошибочность такого скептицизма.

* * *

Комментарий ИА REGNUM

Напомним, что «Римский Призыв к этике ИИ» в конце февраля этого года также подписал генеральный директор Продовольственной и сельскохозяйственной организации ООН (FAO) Цюй Дунъюй. В разрезе сельского хозяйства документ призывает к эффективному использованию возможностей ИИ для создания устойчивых продовольственных систем.

Призыв был также подписан министром IT-инноваций и цифровизации Италии госпожой Паолой Пизано.

Этика взаимодействия ИИ и человека появится в нашей стране совсем скоро — уже в этом году. Такое обещание в декабре 2019 года оставил нам бывший вице-премьер Максим Акимов, говоря о важности четко провести границу между экспертной поддержкой человеческих решений и принятием решения за человека. Разработкой этических норм планировал заняться Сбербанк. Над этикой ИИ правительство призвал задуматься президент РФ Владимир Путин, который на пленарном заседании конференции по искусственному интеллекту Artificial Intelligence Journey, состоявшемся в начале ноября 2019 года, сказал следующее:

Как сообщает РИА «Новости», Московская духовная академия создала на своей базе Центр исследований в области биоэтики и высоких технологий. Центр занимается изучением искусственного интеллекта, робототехники, биодисциплин с точки зрения православного мировоззрения.

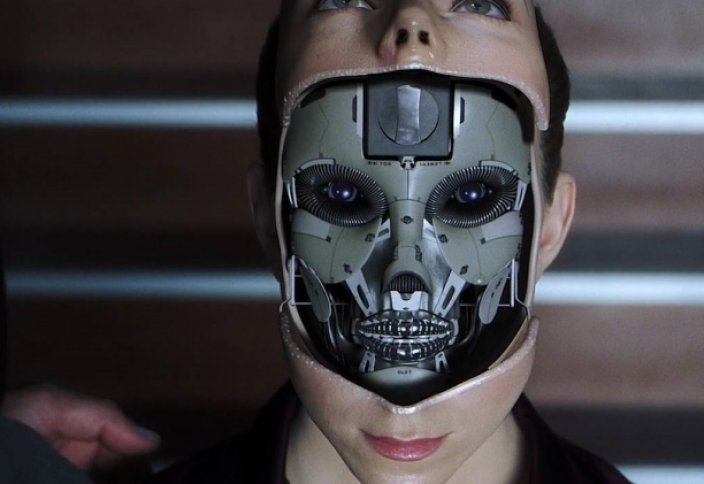

ИИ для массового распознавания лиц несет в себе запредельный риск

Такой ИИ нужно запретить, как, в свое время, запретили ядерные испытания

Сегодня уже не вопрос — какая из новых технологий похоронит права человека, переселив человечество в идеальную е-тюрьму.

ИИ для массового распознавания лиц обеспечит любую власть тотальным контролем над социальной реальностью, сделав эту власть всевидящей и, одновременно, невидимой для общества.

Даже в Объединенной Европе, где граждане защищены строгими законами о неприкосновенности частной жизни, правительства от Лондона до Берлина изо всех сил пытаются использовать технологию массового распознавания лиц. Что же до авторитарных режимов, — то здесь развертывание систем массового распознавания лиц во всю идет (о чем я писал позавчера).

Идя этим путем, мир просто не заметит, как перейдет красную черту, после чего возврат к соблюдению прав человека станет принципиально невозможен. И дело здесь не в возможных злоупотреблениях.

От массовой идентификации путем визуального распознавания через профилирование к биометрическому распознаванию и мониторингу, — таков будет путь человечества к тотальной и безвозвратной потере приватности и отказу от презумпции прав человека.

Вот почему лучшие эксперты ЕС по ИИ подготовили аналитический документ, цель которого — призвать ЕС запретить массовое распознавание лиц, как технологию недопустимо высокого риска.

Подробней в «AI experts call to curb mass surveillance. The EU’s top AI experts say regulation should focus on high-risk applications», и там же ссылка на проект документа экспертов.

Как работает пространственно-временная технология массового распознавания лиц в плотной толпе — фрагмент демо китайской компании Horizon Robotics на CES 2019

В Китае создана 3D-система распознавания лиц, даже если они в масках

Компания из провинции Сычуань на юго-западе Китая разработала трехмерную систему распознавания лиц, которая способно распознавать людей, даже если на них надета маска, сообщает агентство Синьхуа.

Компания Wisesoft совместно с командой исследователей Сычуаньского университета разработала систему, которая способна динамически анализировать трехмерные модели, в отличие от традиционных систем распознавания, опирающихся на двухмерные проекции. Благодаря этому она может распознавать людей, которые носят лицевые маски.

Точность определения системы составляет 98% на тысячу человек, носящих масок, сообщил сотрудник компании Люй Сюэбинь. По его словам, она способна собирать информацию о температуре тела человека и устанавливать их личность, в связи с чем отпадает необходимость личного контакта с медицинским персоналом.

Более 140 систем было установлено в госпиталях Чэнду, столицы провинции. Компания предложит еще 1000 таких систем в ближайшие два месяца.