|

Могут ли технологии искусственного интеллекта изменить международный баланс сил?

|

Мы умнее машин, потому что их создали мы - Станислав Петров

Мелике Танберк ведет исследования по этике больших данных и искусственного интеллекта в Кембриджском университете. Она написала для «Анадолу Анализ» о важности адаптации к технологиям искусственного интеллекта при условии, что человеческий фактор будет оставаться в центре внимания.

***

26 сентября 1983 года советский офицер времен холодной войны Станислав Петров нес службу в командном пункте системы раннего предупреждения ВС СССР. Когда сигнал тревоги сообщил о запуске ракеты из Соединенных Штатов Америки, задачей Петрова было немедленно нанести ответный удар. Однако он колебался, понимая, что серьезные последствия таких действий могут привести к началу Третьей мировой войны и одновременно к прекращению жизни на Земле. Полагая, что это ложная тревога, Петров решил не сообщать о ней и не нажимать кнопку "ОГОНЬ". Эти критические секунды, которые казались вечностью, отражают хрупкий баланс между человеческими суждениями и автоматическими системами, особенно когда речь идет о возможности глобальной катастрофы. В конце концов выяснилось, что система приняла солнечные лучи над облаками за запуск ракеты, что еще раз подчеркивает потенциальную опасность полагаться только на автоматизированные технологии.

Стратегические последствия применения искусственного интеллекта в военных действиях

Со времен эпохального решения Петрова технологии значительно развились, но концепция гонки вооружений осталась неизменной. Сегодня страны вкладывают значительные средства в технологии ИИ, признавая их преобразующий потенциал в различных секторах, включая здравоохранение, промышленность и, что особенно важно, автономные системы вооружений.

Однако споры об этических и стратегических последствиях применения ИИ в военных действиях не утихают, в частности, о передаче полномочий по принятию решений автоматизированным системам в противовес людям-операторам. Продолжающиеся дебаты на эту тему подчеркивают необходимость сбалансированного подхода к развитию ИИ, который учитывал бы мощь технологий, но при этом признавал бы важность человеческого суждения.

Вопрос о том, должны ли страны осуществлять национальные программы в области ИИ, требует рассмотрения более широких последствий технологического суверенитета. Подобно тому, как превосходное оружие испанских конкистадоров изменило динамику развития американского континента в XVI веке, передовые технологии ИИ способны повлиять на геополитическое соперничество и стратегии национальной безопасности в современную эпоху. Страны, не обладающие широкими возможностями ИИ, рискуют поставить под угрозу свой суверенитет и стать уязвимыми для эксплуатации или колонизации, подобно историческим примерам технологического неравенства, приведшего к завоеваниям. Это говорит о необходимости инвестировать в исследования и разработки в области ИИ для защиты интересов национальной безопасности.

Искусственный интеллект в холодной войне

Во многих отношениях мы уже являемся свидетелями того, как искусственный интеллект становится аспектом холодной войны, поскольку великие державы используют возможности искусственного интеллекта для наблюдения, принятия решений и получения стратегического преимущества. Для остального мира адаптация к реалиям этой новой эпохи крайне необходима, чтобы не остаться позади и не столкнуться с тяжелыми последствиями. Центральное место в этой адаптации занимает эффективное использование и контроль данных - жизненной силы алгоритмов ИИ. Государства, которые уделяют приоритетное внимание большим данным и инвестируют в исследования и разработки в области ИИ, имеют больше шансов защитить свои национальные границы в инфосфере.

Возвращаясь к суждению Петрова, следует отметить, что оно служит ярким напоминанием о важности человеческого суждения в эпоху искусственного интеллекта. Даже с развитием технологий сущность государственности включает в себя не только географические границы, но и общие ценности, культурное наследие и коллективное сознание. Поэтому, когда мы пытаемся разобраться со сложностями ИИ в сценарии холодной войны, человеческое принятие решений должно оставаться первостепенным, чтобы предотвратить возможные катастрофы. Как однажды заметил Петров, «мы умнее машин, потому что их создали мы».

Перевод Хатидже Карахан

[Мелике Танберк, мать пятерых детей, окончила Оксфордский университет. Она в настоящее время изучает этику в области больших данных и искусственного интеллекта в Кембриджском университете].

*Мнения, выраженные в статье, принадлежат автору и не обязательно отражают редакционную политику агентства «Анадолу».

Искусственный интеллект все глубже проникает в мировую политику. Как он может изменить баланс сил и почему это опасно?

Искусственный интеллект (ИИ) совсем недавно стал частью повседневной жизни, но уже оказывает неоднозначное влияние на международные отношения. Новейшие технологии используют не только дипломаты и аналитики, их активно внедряют в военную сферу и даже политическую жизнь, что, несомненно, несет много рисков. Про опасность ИИ уже упоминал генеральный секретарь ООН Антониу Гутерриш, в этом же контексте в Европейском союзе идут дискуссии о распространении дезинформации. В свою очередь, парламентские выборы в Индии запомнились многочисленными дипфейками, которые даже оживляли умерших политиков, в Аргентине современные технологии активно использует президент Хавьер Милей, а в США Дональд Трамп и Камала Харрис продолжают обвинять друг друга в распространении фейков, сгенерированных ИИ. Наконец, реальностью становится и грядущая гонка вооружений между ведущими странами в цифровой сфере. В том, как искусственный интеллект применяют в мировой политике и какие угрозы он несет человечеству, разбиралась «Лента.ру».

ИИ в международных отношениях — это совокупность технологий и алгоритмов, которые позволяют обрабатывать большие объемы данных, распознавать закономерности и принимать решения с некоторой степенью автономности.

Его используют для анализа и прогнозирования геополитических событий, обеспечения кибербезопасности, принятия решений в критических ситуациях — например, при разрешении конфликтов и реагировании на стихийные бедствия, а также для содействия переговорам.

Так, дипломаты довольно активно используют цифровые средства в своей работе — от социальных сетей и онлайн-конференций до анализа больших данных, — поэтому ИИ стал для многих довольно ценным инструментом при подготовке материалов, мониторинге информации и переводе. Например, не так давно Израиль представил универсальный языковой перевод в онлайн-режиме на основе искусственного интеллекта, который позволил руководителю цифрового департамента Министерства иностранных дел Дэвиду Саранге говорить на восьми языках без необходимости в посредничестве профессионального переводчика.

Искусственный интеллект за последние годы довольно сильно изменил формат взаимодействия стран на мировой арене. При этом и Россия, и Китай, и США признают, что ИИ может изменить баланс сил в мире.

Еще в 2017 году президент России Владимир Путин сказал: «Искусственный интеллект — это будущее не только России, но и всего человечества». Пять лет спустя генеральный секретарь Коммунистической партии Китая Си Цзиньпин заявил: «Мы сосредоточимся на национальных стратегических потребностях, соберем силы для проведения местных и ведущих научно-технических исследований и решительно выиграем битву за ключевые базовые технологии». В 2023 году же президент США Джо Байден подытожил, что будет означать ИИ для человечества: «В ближайшие 10 лет, а может быть, и в ближайшие 5 лет мы увидим больше технологических изменений, чем за последние 50 лет [...]. Искусственный интеллект ускоряет эти изменения».

Фото: Bruna Casas / Reuters

Распространение ИИ может привести к новому дисбалансу на мировой арене. В то время как некоторые страны используют преимущества искусственного интеллекта, другие отстают в развитии и оказываются в невыгодном положении. Конкуренция за обладание этой технологией усиливается, а сам искусственный интеллект становится ключевым фактором роста экономической и военной мощи.

По прогнозам Международного валютного фонда (МВФ), развитие ИИ может привести к автоматизации более 40 процентов рабочих мест во всем мире, при этом его влияние будет особенно заметно в сфере высококвалифицированного труда. Это даст странам с развитой экономикой значительное преимущество перед развивающимися странами, усугубляя существующий дисбаланс мирового развития и социальное неравенство.

Потенциал искусственного интеллекта, кроме того, могут в будущем использовать не только для разрешения старых конфликтов, но и для создания новых. Подобно разработке беспилотных летательных аппаратов (БПЛА) для наблюдения и разведки в боевых условиях, глобальное расширение использования ИИ может оказаться еще одним трамплином для применения новых технологий в космических и военных целях. Китай, например, активно ведет разработку спутников с поддержкой ИИ.

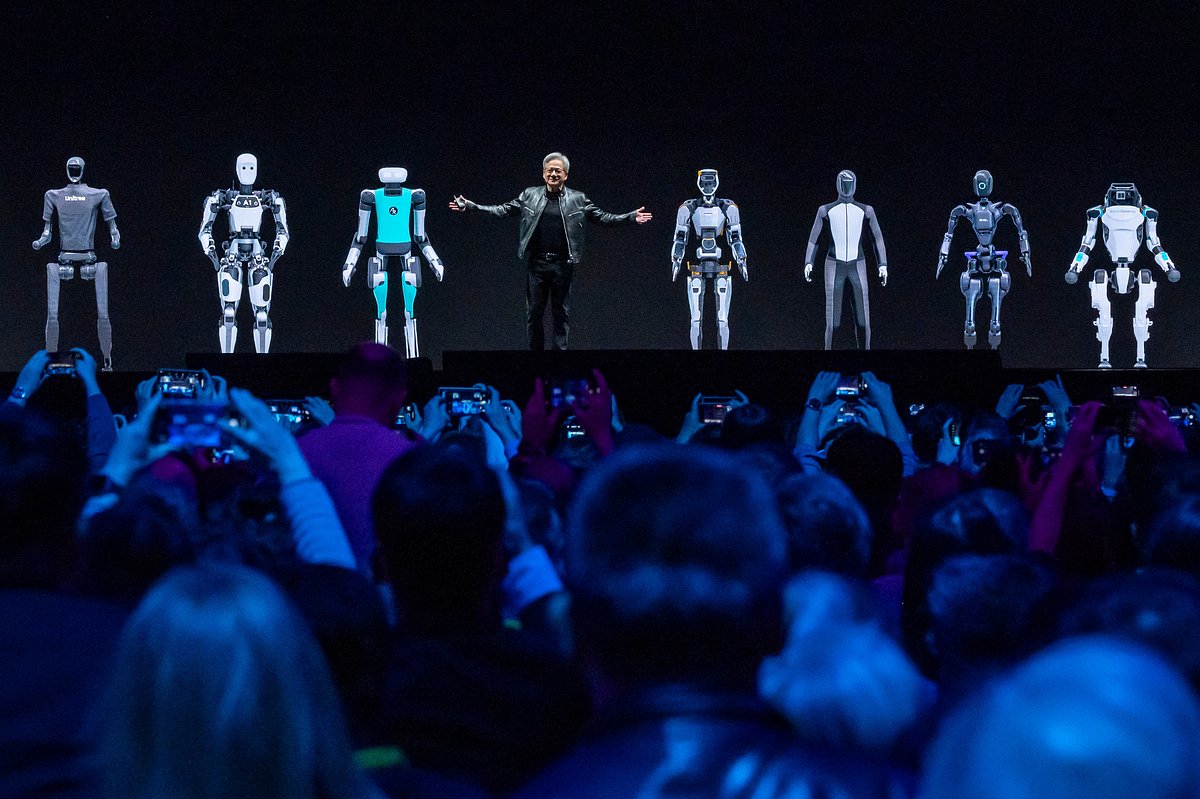

Фото: David Paul Morris / Bloomberg / Getty Images

ИИ оказывает при этом все большее влияние на сферу кибербезопасности, причем как для защиты, так и для нападения. Дело в том, что технология способна анализировать миллионы событий в цифровой среде, выявлять различные типы угроз и даже поведение человека в сети, а также определять, кто наиболее уязвим к фишинговым атакам

ИИ способен докопаться до систем, сетей, баз данных и моделей поведения, чтобы обнаружить даже малейшие аномалии, повышающие вероятность киберугроз. Это дает понимание того, что может быть использовано для атаки и какова ее вероятность.В то же время ИИ может усиливать и сами киберугрозы. Преступные киберструктуры, идеологические и государственные хакеры также используют технологию, чтобы преодолевать защиту и избегать обнаружения. ИИ, более того, позволяет разрабатывать постоянно мутирующее вредоносное ПО, ускользающее от обнаружения.

ИИ уже активно применяется военными, в том числе в вооруженных конфликтах.

AUKUS, трехсторонний оборонный альянс, образованный Австралией, Великобританией и США, уже испытывал автономные системы вооружения для усиления конкуренции с Китаем. Оружие с искусственным интеллектом применялось в Ливии, Йемене и на Украине. Армия обороны Израиля использовала ИИ для выбора целей при ударах по объектам палестинского движения ХАМАС в секторе Газа.

Направлений использования искусственного интеллекта в этой сфере довольно много. ИИ, например, позволяет сохранять жизни военнослужащих и делегировать опасные задачи роботам, которые могут исследовать местность, обезвреживать взрывчатку, переносить оборудование.

ИИ также влияет на процесс принятия решений: точный анализ данных помогает эффективнее выявлять и поражать противника. Автоматизированные системы принимают разумные решения с минимумом ошибок, используя информацию от беспилотников.

Однако использование искусственного интеллекта военными вызывает довольно большие опасения из-за потенциальных угроз. Во-первых, это связано с тем, что развитие технологии влияет на такие важные сферы, как разработка автономных систем вооружения, контроль и применение ядерного оружия, сбор разведывательных данных. Так, существует риск взлома и манипулирования ИИ-системами противником, что может привести к краже конфиденциальной информации. Во-вторых, ИИ остается непредсказуемым, и в случае сбоев или ошибок трудно определить ответственного, что может привести к непреднамеренному ущербу для гражданского населения.

Фото: Johannes Simon / Getty Images

Одна из ключевых сфер применения ИИ — ядерная наука, а именно исследования в области термоядерного синтеза, где искусственный интеллект помогает проводить эксперименты через моделирование и анализ данных. Этому, в частности, посвящен проект Международного агентства по ядерной энергии (МАГАТЭ), направленный на применение технологии в проектировании реакторов, эксплуатации АЭС, а также в обучении сотрудников атомных электростанций.

ИИ применяют для обеспечения ядерной и физической безопасности, обработки данных систем радиационного контроля и защиты, а также интеграции в ПО, связанное с радиационной защитой персонала. При этом ИИ обладает довольно большим потенциалом для оптимизации множества процессов на атомных электростанциях — например, позволяет регулировать выработку электроэнергии на основе данных о спросе потребителей, погодных условиях и производительности оборудования в реальном времени.

Автоматизация с помощью робототехники и систем ИИ может выполнять рутинные задачи, повышать эффективность использования ядерного топлива и максимизировать энергетический выход реакторов.

Фото: Keystone Press Agency / Globallookpress.com

Развитие новых технологий, в особенности ИИ, усиливает при этом новую технологическую гонку между странами.

В июне американский ИИ-гигант OpenAI ограничил доступ к своему сайту из Китая и специального района этой страны Гонконга. Событие стало поворотным моментом в развитии ИИ, поскольку оно показало, что конкуренция между ведущими странами в этой области начала обостряться.

Пока что Китай лидирует в военных ИИ-инновациях, но отстает от США в других сферах применения ИИ. Например, китайские языковые модели отстают от американских на несколько лет, также OpenAI доминирует в генеративных моделях. При этом достижения Китая подтолкнули США к введению санкций — например, к наложению ограничений на экспорт чипов, что лишило Китай доступа к ключевой аппаратной инфраструктуре для развития своих ИИ-систем.

Страна же, которая первой преуспеет в гонке ИИ, претендует на мировое господство, считает издание Foreign Affairs.

Однако технологическая гонка XXI века, которая напоминает космическую гонку XX века, несет большие риски. Во-первых, попытки обогнать соперников могут привести к быстрому расширению возможностей ИИ, которые еще не до конца изучены и контролируемы. Во-вторых, ИИ создает риски для безопасности из-за его милитаризации: искусственный интеллект становится новой частью третьей технической революции в военном деле и превосходит предыдущие разработки в сфере вооружений.

Вадим Козюлин, заведующий Центром глобальных исследований и международных отношений Дипломатической академии МИД России, в разговоре с «Лентой.ру» заявил, что сейчас избежать гонки вооружений в сфере новейших технологий вряд ли удастся. «Тот, кто отстанет в гонке современных технологий (и в гонке военных технологий), в случае конфликта рискует проиграть в течение очень короткого периода», — считает эксперт.

Фото: Leon Neal / Getty Images

Международные соглашения времен холодной войны о нераспространении ядерного оружия и запрете биологического оружия помогли урегулировать гонку вооружений и поддержать мир. Подобные договоренности по ИИ также могут предотвратить его неконтролируемое применение.

В условиях международной напряженности расширение сотрудничества по вопросам развития ИИ может снизить риск несогласованного внедрения этих технологий в военной сфере. Это, в свою очередь, уменьшит вероятность технологических катастроф и будет способствовать более осторожному и устойчивому развитию ИИ.

Но при этом в сфере ИИ странам очень трудно договориться даже о том, что можно контролировать, отметил в комментарии для «Ленты.ру» научный сотрудник Центра международной безопасности Института мировой экономики и международных отношений РАН Дмитрий Стефанович.

«В отличие от более традиционных сфер контроля над вооружениями и нераспространением, в которых тоже не все гладко, в случае с ИИ по большому счету отсутствует измеряемый предмет для контроля», — отметил эксперт. По его мнению, странам сначала надо сформировать общее понимание, что представляет собой ИИ в сфере международной безопасности. Без этого, по словам Дмитрия Стефановича, снижения накала конкуренции ожидать не стоит.

С ним соглашается и политолог Вадим Козюлин. По его словам, желание и готовность договориться у ведущих стран присутствует и это действительно нужно, но есть много неопределенностей: «Тема очень сложная юридически и технически. Пока не очень понятно, как эту быстро развивающуюся сферу можно контролировать. Старые схемы здесь не работают».